Päivitetty 17.4.2019.

Jos datani pohjautuu laajemmasta perusjoukosta satunnaisesti valittuun otokseen, niin tietyin edellytyksin voin yleistää otoksen tuloksia perusjoukkoon. Ristiintaulukoinnin tapauksessa tämä tarkoittaa taulukossa havaitun riippuvuuden tai ryhmien välisen eron yleistämistä perusjoukkoon.

Otoksessa havaitun riippuvuuden tai ryhmien välisen eron täytyy olla riittävän suuri, jotta voin yleistää sen perusjoukkoon. Jos riippuvuus tai ryhmien välinen ero on pieni, niin tämän voin selittää otantavirheellä. Riippuvuuden tai eron suuruutta testaan vertaamalla hypoteettiseen tilanteeseen, jossa ei ole lainkaan riippuvuutta tai lainkaan eroja ryhmien välillä. Vertailun toteuttamiseksi lasken ristiintaulukoinnin rinnalle toisen ristiintaulukoinnin, joka vastaa hypoteettista tilannetta.

Tärkeää: Vaikka ristiintaulukoinnissa on havainnollisempaa esittää prosentit kuin lukumäärät, niin khiin neliö -testauksen lähtökohtana käytetään aina lukumääriä.

Hypoteettisen ristiintaulukoinnin laskeminen

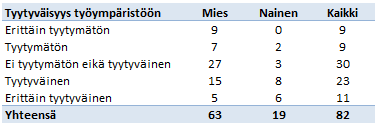

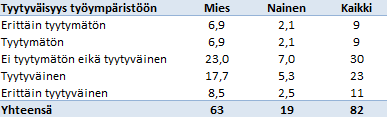

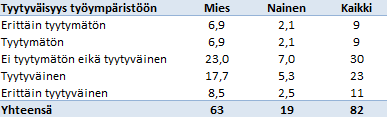

Käytän seuraavassa esimerkkidataa data1.xlsx. Datasta laskettu sukupuolen ja tyytyväisyys työympäristöön välinen ristiintaulukointi näyttää seuraavalta:

Taulukossa on havaittavissa ero miesten ja naisten mielipiteissä (naiset tyytyväisempiä). Eron suuruuden selville saamiseksi lasken hypoteettisen ristiintaulukoinnin, jossa eroa ei ole. Hypoteettisessa taulukossa miesten ja naisten yhteismäärien pitää olla havaitun taulukon mukaiset samoin eri mielipiteitä omaavien yhteismäärät.

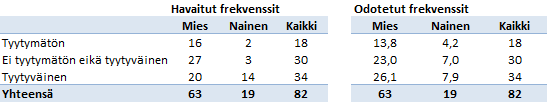

Hypoteettisen taulukon lukumäärät saan kertomalla havaitun taulukon rivi- ja sarakesummat keskenään ja jakamalla kokonaissummalla (82). Esimerkiksi erittäin tyytymättömien miesten lukumääräksi saan (9*63)/82 eli noin 6,9. Laskentamenetelmä perustuu todennäköisyyslaskentaan:

- Jos erittäin tyytymättömiä on 9, niin todennäköisyys sille että otoksesta sattumanvaraisesti valittu on erittäin tyytymätön on 9/82.

- Jos miehiä on 63, niin todennäköisyys sille että otoksesta sattumanvaraisesti valittu on mies on 63/82.

- Todennäköisyyden sille että otoksesta sattumanvaraisesti valittu on erittäin tyytymätön mies saan kertomalla todennäköisyydet 9/82 ja 63/82 keskenään. Kyseinen todennäköisyys kertoo samalla erittäin tyytymättömien miesten prosenttiosuuden siinä tapauksessa että miesten ja naisten mielipiteillä ei ole eroa.

- Laskemalla erittäin tyytymättömien miesten lukumäärä erittäin tyytymättömien miesten prosenttiosuutta käyttäen saan (9/82)*(63/82)*82. Sievennyksen jälkeen tästä tulee (9*63)/82.

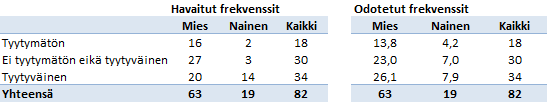

Jos lasken taulukon muihin soluihin lukumäärät vastaavalla tavalla (rivisumman ja sarakesumman tulo jaettuna kokonaissummalla), niin saan seuraavan taulukon:

Taulukon lukumääriä kutsutaan odotetuiksi lukumääriksi tai odotetuiksi frekvensseiksi (expected frequencies) ja ne siis vastaavat hypoteettista tilannetta, jossa sukupuolen ja mielipiteen välillä ei ole riippuvuutta (miesten ja naisten mielipiteissä ei ole eroa).

Testin käyttöedellytykset

Havaitun taulukon ja hypoteettisen taulukon eron testaaminen ei ole luotettavaa, jos hypoteettisen taulukon lukumäärät eli odotetut frekvenssit ovat liian pieniä. Kirjallisuudessa annetaan hieman toisistaan poikkeavia rajoja sille, milloin testaaminen muuttuu epäluotettavaksi. Monissa lähteissä esitetään seuraavat kriteerit testaamisen luotettavuudelle:

- Taulukossa, jossa on kaksi riviä ja kaksi saraketta (2×2 taulukko) ei saa olla yhtään alle viiden (5) suuruista odotettua frekvenssiä.

- Suuremmissa taulukoissa alle viiden (5) suuruisia odotettuja frekvenssejä saa olla viidesosa (20 %) kaikista odotetuista frekvensseistä. Alle yhden (1) suuruisia odotettuja frekvenssejä ei saa olla lainkaan.

Edellä lasketussa taulukossa on kolme alle viiden suuruista odotettua frekvenssiä eli 3/10=30 % kaikista. Tämä on liikaa.

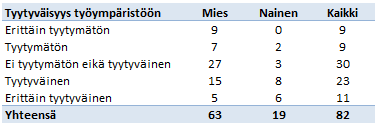

Esimerkissäni voin luontevasti yhdistää mielipiteitä (erittäin tyytymätön ja tyytymätön yhteen sekä erittäin tyytyväinen ja tyytyväinen yhteen). Näin taulukko pienenee 5×2 taulukosta 3×2 taulukoksi, jolloin taulukon lukumäärät kasvavat. Esimerkissäni mielipiteiden yhdistäminen korjaa tilanteen eikä alle viiden suuruisia odotettuja frekvenssejä ole kuin 1 (1/6 eli 17 % kaikista).

Khiin neliö Χ²

Havaitun ja hypoteettisen taulukon eroa voin mitata khiin neliö -testimuuttujalla. Khiin neliön merkkinä käytetään kreikkalaista isoa khi-kirjainta varustettuna yläindeksillä 2 (Χ²). Khi-kirjaimen sijasta voin käyttää myös isoa X-kirjainta. En selitä tässä khiin neliö -testimuuttujan laskemista, mutta halutessasi voit lukea testimuuttujan laskemisesta ja khiin neliö -jakaumasta artikkelista Khiin neliö -testi – lisätietoa.

Khiin neliö -testimuuttujan tiedetään noudattavan likimain khiin neliö -todennäköisyysjakaumaa, jonka tarkka muoto riippuu vapausasteluvusta df (degrees of freedom). Vapausasteita on (rivien määrä-1)×(sarakkeiden määrä-1). Esimerkiksi 2×2 taulukossa df=(2-1)×(2-1)=1. Tämän voi ymmärtää helposti: Jos taulukon rivi- ja sarakesummat ovat tiedossa, niin ainoastaan yhden arvon voi asettaa 2×2 taulukkoon vapaasti; muut arvot määräytyvät tämän perusteella.

Khiin neliö -testi

Khiin neliö -testissä määritetään khiin neliö -todennäköisyysjakaumasta niin kutsuttu p-arvo, joka vastaa seuraavaan kysymykseen: Kuinka todennäköistä on saada havaitun suuruinen tai vielä suurempi khiin neliö -testimuuttujan arvo ilman riippuvuutta tai eroa perusjoukossa? Mitä pienempi p-arvo on, sitä enemmän riippuvuuden tai eron yleistäminen perusjoukkoon saa tukea. Toisaalta, mitä suurempi p-arvo on, sitä todennäköisemmin havaitut erot johtuvat otantavirheestä.

Vakiintuneen tavan mukaan alle 0,050 (5,0 %) suuruista p-arvoa pidetään riittävänä näyttönä perusjoukossa olevan riippuvuuden tai eron puolesta.

Excelissä voin laskea p-arvon CHISQ.TEST (CHINELIÖ.TESTI) -funktiolla. Funktiolle annetaan kaksi argumenttia: viittaus havaittuihin frekvensseihin ja viittaus odotettuihin frekvensseihin. Excel 2007 ja vanhemmissa versioissa funktion nimi on CHITEST (CHITESTI). Vanha funktion nimi toimii edelleen myös uudemmissa versioissa.

Khiin neliö -testin raportointi

Esimerkissäni mielipiteiden yhdistämisen jälkeen laskettu khiin neliö -testi antaa p-arvoksi 0,005. Tuloksen voin raportoida esimerkiksi seuraavasti: Miesten ja naisten mielipiteissä on merkitsevää eroa (khiin neliö -testin p-arvo 0,005). Tieteellisessä tekstissä tulos on hyvä raportoida vieläkin täsmällisemmin ilmoittamalla vapausasteiden lukumäärä (df) ja khiin neliö -testimuuttujan arvo: Khiin neliö -testin mukaan miesten (n=63) ja naisten (n=19) mielipiteissä on eroa: df=2; Χ²(2)=10,59; p=0,005.

Excel laskee puolestasi

Onneksi jaksoit lukea tänne asti. Kaikkea ei tarvitse laskea alusta alkaen. Voit käyttää rakentamiani taulukkopohjia otantavirhe.xlsx, joihin voit kirjoittaa tai kopioida oman taulukkosi lukumäärät. Tämän jälkeen näet suoraan odotetut frekvenssit, khiin neliön Χ², vapausasteiden lukumäärän df ja p-arvon. Sinun tehtäväksesi jää tulosten raportointi.

Jos haluat laskea khiin neliö -testin SPSS:llä, niin lue artikkeli SPSS: Khiin neliö -testi.

Yhteenveto

Jos otoksesta lasketussa ristiintaulukoinnissa näkyy ryhmien välisiä eroja, niin

- Mitä pienempi p-arvo, sitä enemmän saan tukea väitteelle, että myös perusjoukossa on ryhmien välisiä eroja. Yleensä alle 0,050 (5,0 %) suuruista p-arvoa pidetään varsin hyvänä tukena väitteelle, että myös perusjoukossa on ryhmien välisiä eroja.

- mitä isompi p-arvo, sitä todennäköisemmin otoksessa havaitut erot johtuvat pelkästään otantavirheestä.

Vaihtoehtoja khiin neliö -testille

Khiin neliö -testi soveltuu käytettäväksi erityisesti kahden kategorisen muuttujan tapauksessa. Jos toinen muuttujista on mielipideasteikollinen, niin Mann-Whitney U -testi (kahden ryhmän vertailu) tai Kruskal-Wallis -testi (useamman ryhmän vertailu) ovat suositeltavampia testimenetelmiä. Tämän artikkelin esimerkissä toisena muuttujana on mielipideasteikollinen muuttuja. Esimerkissä tuleekin ongelmia khiin neliö -testin käyttöedellytysten kanssa. Mann-Whitney U -testissä ei tule ongelmia käyttöedellytysten kanssa. Valitettavasti Excelissä ei ole toimintoa Mann-Whitney U -testin tai Kurskal-Wallis -testin laskemiseen.